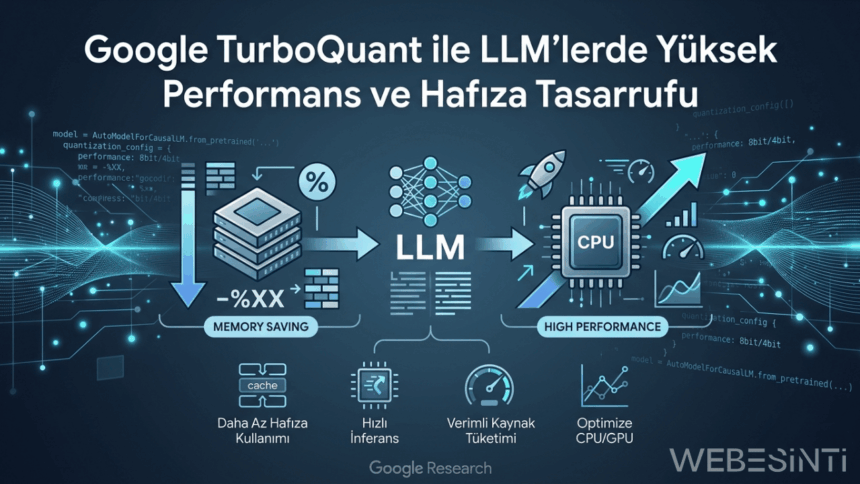

Google Research, büyük dil modelleri (LLM) için TurboQuant adını verdiği yeni bir kvanizasyon algoritmasını duyurdu. Bu teknoloji, KV-cache boyutunu 3 bitle düşürürken model doğruluğunda kayıp yaşamadan çalışıyor ve ek bir eğitim gerektirmiyor.

TurboQuant’un Temel Avantajları

- KV-cache optimizasyonu: 4-bit TurboQuant, Nvidia H100 hızlandırıcılarda 32-bit anahtarlarla karşılaştırıldığında, dikkat logit hesaplamalarında 8 kat hızlanma sağlıyor.

- Hafıza tasarrufu: KV-cache boyutu 6 kat küçülüyor, böylece büyük bağlam pencerelerine sahip modellerde önemli bir bellek kazanımı elde ediliyor.

TurboQuant Nasıl Çalışıyor?

PolarQuant Aşaması:

Vektörler, Kartezyen koordinatlardan polar koordinatlara dönüştürülüyor; her vektör bir yarıçap ve açı değeri alıyor. Açısal dağılımlar öngörülebilir olduğu için klasik kvanlaştırıcılarda gerekli olan blok normalizasyonuna gerek kalmıyor ve yüksek kaliteli sıkıştırma elde ediliyor.

Hata Düzeltme Katmanı:

1-bitlik bir hata düzeltme katmanı, Johnson-Lindenstrauss algoritması temel alınarak çalışıyor. Kalan hata, daha düşük boyutlu bir uzaya projelendirilip tek bit ile kodlanıyor, böylece sistematik hata minimuma indiriliyor.

Test ve Performans Sonuçları

Google, TurboQuant’u LongBench, Needle In A Haystack, ZeroSCROLLS, RULER ve L-Eval gibi uzun bağlam test setlerinde Gemma ve Mistral modellerinde test etti. Sonuçlar:

- KV-cache boyutu 6 kat küçüldü,

- Bazı görevlerde klasik KIVI yöntemini geride bıraktı,

- Kod üretimi, soru-cevap ve özetleme görevlerinde yüksek doğruluk sağladı.

Ayrıca vektör arama görevlerinde Product Quantization ve RabbiQ yöntemlerine göre daha iyi sonuçlar verdi. TurboQuant, ince ayar gerektirmeyen, düşük maliyetli ve yüksek yük altında bile uygulanabilir bir çözüm sunuyor.

Özetle, Google TurboQuant ile büyük dil modellerinde hem performans hem de bellek verimliliği önemli ölçüde artırılırken, ek eğitim veya karmaşık optimizasyon süreçlerine ihtiyaç kalmıyor. Bu teknoloji, LLM’lerde KV-cache yönetiminde yeni bir standart yaratma potansiyeline sahip.